Mantenerse al día con una industria tan movida como la inteligencia artificial es todo un desafío. Por eso, hasta que una IA pueda hacerlo por ti, aquí tienes un práctico resumen de historias recientes en el mundo del aprendizaje automático, junto con investigaciones y experimentos notables que no cubrimos por separado.

Esta semana, fue imposible ignorar -para este reportero incluido, para desgracia de mi cansado cerebro- la controversia de liderazgo en torno a la startup de IA OpenAI. La junta directiva destituyó a Sam Altman, CEO y cofundador, presuntamente por lo que consideraron prioridades equivocadas: comercializar la IA a expensas de la seguridad.

Altman fue -en gran parte gracias a los esfuerzos de Microsoft, un importante patrocinador de OpenAI- restituido como CEO y la mayor parte de la junta original fue reemplazada. Pero la saga ilustra los peligros de las empresas de IA, incluso de las tan grandes e influyentes como OpenAI, a medida que la tentación de aprovechar fuentes de financiamiento orientadas a la monetización se hace cada vez más fuerte.

No es que los laboratorios de IA necesariamente quieran involucrarse con empresas de capital de riesgo y gigantes tecnológicos ávidos de retornos comerciales. Es que los costos muy altos de entrenar y desarrollar modelos de IA hacen casi imposible evitar este destino.

Según CNBC, el proceso de entrenar un gran modelo de lenguaje como GPT-3, predecesor del modelo de IA generador de texto insignia de OpenAI, GPT-4, podría costar más de $4 millones. Esa estimación no incluye los costos de contratar científicos de datos, expertos en IA e ingenieros de software, todos los cuales tienen salarios altos.

No es casualidad que muchos laboratorios de IA grandes tengan acuerdos estratégicos con proveedores de nube públicos; la potencia informática, especialmente en un momento en que los chips para entrenar modelos de IA escasean (beneficiando a proveedores como Nvidia), se ha vuelto más valiosa que el oro para estos laboratorios. El principal rival de OpenAI, Anthropic, ha recibido inversiones tanto de Google como de Amazon, y Character.ai, mientras tanto, cuenta con el respaldo de Google Cloud, que también es su proveedor exclusivo de infraestructura informática.

Pero, como mostró esta semana, estas inversiones conllevan riesgos. Los gigantes tecnológicos tienen sus propias agendas, y el peso para hacer que se cumplan sus deseos.

El intento de OpenAI de mantener cierta independencia con una estructura única de «ganancias limitadas» que limita los retornos totales de los inversionistas. Pero Microsoft demostró que la potencia informática puede ser tan valiosa como el capital para someter a una startup; buena parte de la inversión de Microsoft en OpenAI es en forma de créditos de Azure en la nube, y la amenaza de retener estos créditos sería suficiente para captar la atención de cualquier junta directiva.

A menos que haya aumentos masivos en las inversiones en recursos públicos de supercomputación o programas de subvenciones de IA, es poco probable que el statu quo cambie pronto. Las startups de IA de cierto tamaño -como la mayoría de las startups- se ven obligadas a ceder el control sobre su destino si desean crecer. Con suerte, a diferencia de OpenAI, hacen un trato con el demonio que conocen.

Aquí hay algunas otras historias de IA destacadas de los últimos días:

OpenAI no va a destruir a la humanidad: ¿Ha inventado OpenAI tecnología de IA con el potencial de «amenazar a la humanidad»? A juzgar por algunos titulares recientes, podrías pensar que sí. Pero los expertos dicen que no hay motivo de alarma.

California enfoca las reglas de IA: La Agencia de Protección de la Privacidad de California se está preparando para su próximo truco: poner límites a la IA. Natasha escribe que el regulador de privacidad estatal publicó recientemente regulaciones preliminares sobre cómo se puede utilizar los datos de las personas para IA, inspirándose en las normas existentes en la Unión Europea.

Bard responde preguntas de YouTube: Google ha anunciado que su chatbot de IA, Bard, ahora puede responder preguntas sobre videos de YouTube. Aunque Bard ya tenía la capacidad de analizar videos de YouTube con el lanzamiento de la Extensión de YouTube en septiembre, el chatbot ahora puede ofrecerte respuestas específicas sobre consultas relacionadas con el contenido de un video.

Grok de X está listo para lanzarse: Poco después de que aparecieran capturas de pantalla mostrando al chatbot Grok de xAI en la aplicación web de X, el propietario de X, Elon Musk, confirmó que Grok estaría disponible para todos los suscriptores Premium+ de la empresa en algún momento de esta semana. Aunque los pronunciamientos de Musk sobre plazos de entrega de productos no siempre se han cumplido, los desarrollos de código en la propia aplicación de X revelan que la integración de Grok está en marcha.

Stability AI lanza un generador de videos: La startup de IA Stability AI anunció la semana pasada Stable Video Diffusion, un modelo de IA que genera videos animando imágenes existentes. Basado en el modelo Stable Diffusion de Stability para convertir texto en imágenes, Stable Video Diffusion es uno de los pocos modelos generadores de videos disponibles en código abierto, o comercialmente, por cierto.

Anthropic lanza Claude 2.1: Anthropic lanzó recientemente Claude 2.1, una mejora en su modelo de lenguaje grande que lo mantiene competitivo con la serie GPT de OpenAI. Devin escribe que la nueva actualización de Claude tiene tres mejoras principales: ventana de contexto, precisión y extensibilidad.

OpenAI y la IA abierta: Paul escribe que el debacle de OpenAI ha puesto de relieve las fuerzas que controlan la incipiente revolución de la IA, lo que lleva a muchos a preguntarse qué sucede si te comprometes por completo con un jugador propietario centralizado, y qué sucede si luego las cosas salen mal.

AI21 Labs recauda dinero: AI21 Labs, una empresa que desarrolla productos de IA generativa al estilo de GPT-4 y ChatGPT de OpenAI, recaudó la semana pasada $53 millones, lo que eleva su recaudación total a $336 millones. Una startup con sede en Tel Aviv que crea una variedad de herramientas de IA generadoras de texto, AI21 Labs fue fundada en 2017 por Amnon Shashua, cofundador de Mobileye, Ori Goshen y Yoav Shoham, otro co-CEO de la startup.

Más aprendizajes de máquinas

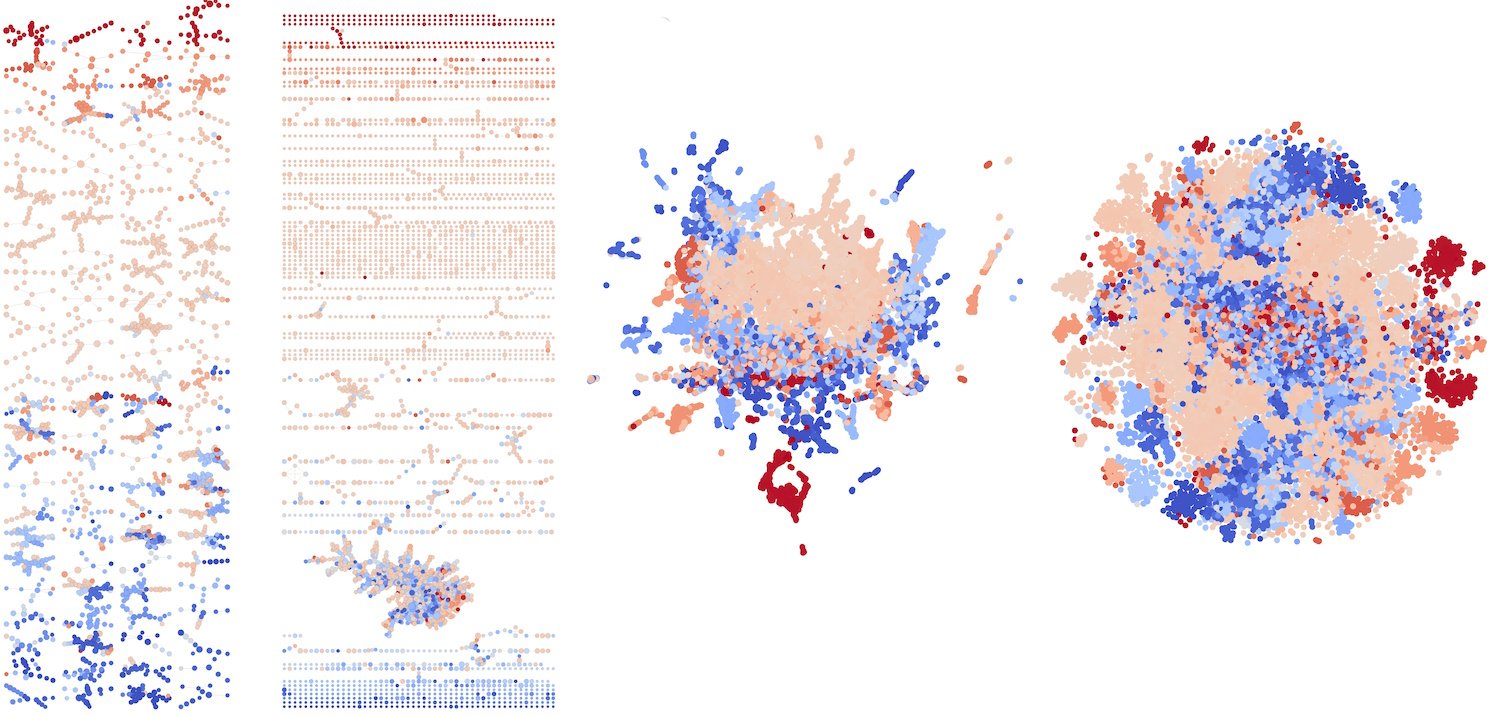

Hacer que los modelos de IA sean más sinceros sobre cuándo necesitan más información para producir una respuesta segura es un problema difícil, ya que realmente, el modelo no distingue entre lo correcto y lo incorrecto. Pero al hacer que el modelo exponga un poco de su funcionamiento interno, se puede tener una mejor idea de cuándo es más probable que esté mintiendo.

Créditos de la imagen: Purdue University

Este trabajo de Purdue crea un «mapa Reeb» legible para humanos sobre cómo la red neuronal representa conceptos visuales en su espacio vectorial. Los elementos que considera similares se agrupan, y las superposiciones con otras áreas podrían indicar similitudes entre esos grupos o confusión en la parte del modelo. «Lo que estamos haciendo es tomar estos complicados conjuntos de información que salen de la red y dar a las personas una ‘entrada’ sobre cómo la red ve los datos a nivel macroscópico», dijo el investigador principal David Gleich.

Créditos de la imagen: Laboratorio Nacional de Los Álamos

Si su conjunto de datos es limitado, lo mejor es no extrapolar demasiado de él, pero si es necesario… quizás una herramienta como «Senseiver», del Laboratorio Nacional de Los Álamos, es su mejor opción. El modelo se basa en el Perceiver de Google, y es capaz de tomar un puñado de medidas dispersas y, aparentemente, hacer predicciones sorprendentemente precisas al rellenar los vacíos.

Estos pueden ser datos como mediciones climáticas, otras lecturas científicas o incluso datos tridimensionales como mapas de baja fidelidad creados por escáneres de gran altitud. El modelo puede ejecutarse en computadoras perimetrales, como drones, que ahora pueden realizar búsquedas de características específicas (en su caso de prueba, fugas de metano) en lugar de simplemente leer los datos y llevarlos de vuelta para ser analizados más tarde.

Mientras tanto, los investigadores están trabajando en hacer que el hardware que ejecuta estas redes neuronales sea más como una red neuronal en sí misma. Crearon una matriz de 16 electrodos y luego la cubrieron con una capa de fibras conductoras en una red aleatoria pero consistentemente densa. Donde se superponen, estas fibras pueden formar conexiones o romperlas, dependiendo de varios factores. De cierta manera, es como las neuronas en nuestro cerebro que forman conexiones y luego refuerzan o abandonan dinámicamente esas conexiones.

El equipo de UCLA/Universidad de Sídney dijo que la red pudo identificar números escritos a mano con una precisión del 93.4%, lo que en realidad superó a un enfoque más convencional a una escala similar. Es fascinante, sin duda, pero está lejos de ser de uso práctico, aunque las redes autoorganizadas probablemente encontrarán su lugar en la caja de herramientas eventualmente.

Créditos de la imagen: UCLA/Universidad de Sídney

Es genial ver cómo los modelos de aprendizaje automático ayudan a las personas, y tenemos algunos ejemplos de eso esta semana.

Un grupo de investigadores de Stanford está trabajando en una herramienta llamada GeoMatch destinada a ayudar a refugiados e inmigrantes a encontrar el lugar adecuado para su situación y habilidades. No es un procedimiento automatizado: actualmente estas decisiones las toman los oficiales de colocación y otros funcionarios que, aunque experimentados e informados, no siempre pueden estar seguros de que sus decisiones estén respaldadas por datos. El modelo de GeoMatch toma varias características y sugiere un lugar donde la persona probablemente encontrará empleo sólido.

«Lo que una vez llevó a varias personas horas de investigación ahora se puede hacer en minutos», dijo el líder del proyecto, Michael Hotard. «GeoMatch puede ser increíblemente útil como una herramienta que simplifica el proceso de recopilación de información y establecimiento de conexiones».

En la Universidad de Washington, los investigadores en robótica acaban de presentar su trabajo sobre la creación de un sistema de alimentación automatizado para personas que no pueden comer por sí solas. El sistema ha pasado por muchas versiones y ha evolucionado con la retroalimentación de la comunidad, y «hemos llegado al punto en que podemos recoger casi todo lo que puede manejar un tenedor. Así que no podemos recoger sopa, por ejemplo. Pero el robot puede manejar desde puré de papas o fideos hasta una ensalada de frutas o una ensalada de verduras reales, así como pizza pre cortada o un sándwich o trozos de carne», dijo el co-líder Ethan K. Gordon en una sesión de preguntas y respuestas publicada por la universidad.

Créditos de la imagen: Universidad de Washington

Es una charla interesante, que muestra cómo proyectos como estos nunca están realmente «terminados», pero en cada etapa pueden ayudar cada vez a más personas.

Hay algunos proyectos por ahí para ayudar a personas ciegas a moverse por el mundo, desde Be My AI (impulsado por GPT-4V) hasta Seeing AI de Microsoft, una colección de modelos diseñados para tareas cotidianas. Google tenía su propio, una aplicación de navegación llamada Project Guideline que estaba destinada a ayudar a mantener a las personas en el camino correcto al caminar o trotar por un sendero. Google acaba de hacerlo de código abierto, lo que generalmente significa que están renunciando a algo, pero su pérdida es una ganancia para otros investigadores, porque el trabajo realizado en la empresa multimillonaria ahora puede ser utilizado en un proyecto personal.

Por último, un poco de diversión en FathomVerse, un juego/herramienta para identificar criaturas marinas de la misma manera que aplicaciones como iNaturalist y otras identifican hojas y plantas. Sin embargo, necesita tu ayuda, porque animales como anémonas y pulpos son blandos y difíciles de identificar. ¡Así que regístrate para la versión beta y averigua si puedes ayudar a que este proyecto despegue! Créditos de la imagen: FathomVerse