Tras una serie de demandas y críticas por supuestamente no proteger a sus usuarios menores de edad de daños, Character AI, la startup que permite a los usuarios crear diferentes personajes de inteligencia artificial y hablar con ellos a través de llamadas y mensajes de texto, anunció el martes que está implementando un nuevo conjunto de herramientas de supervisión parental para aumentar la seguridad de sus usuarios adolescentes.

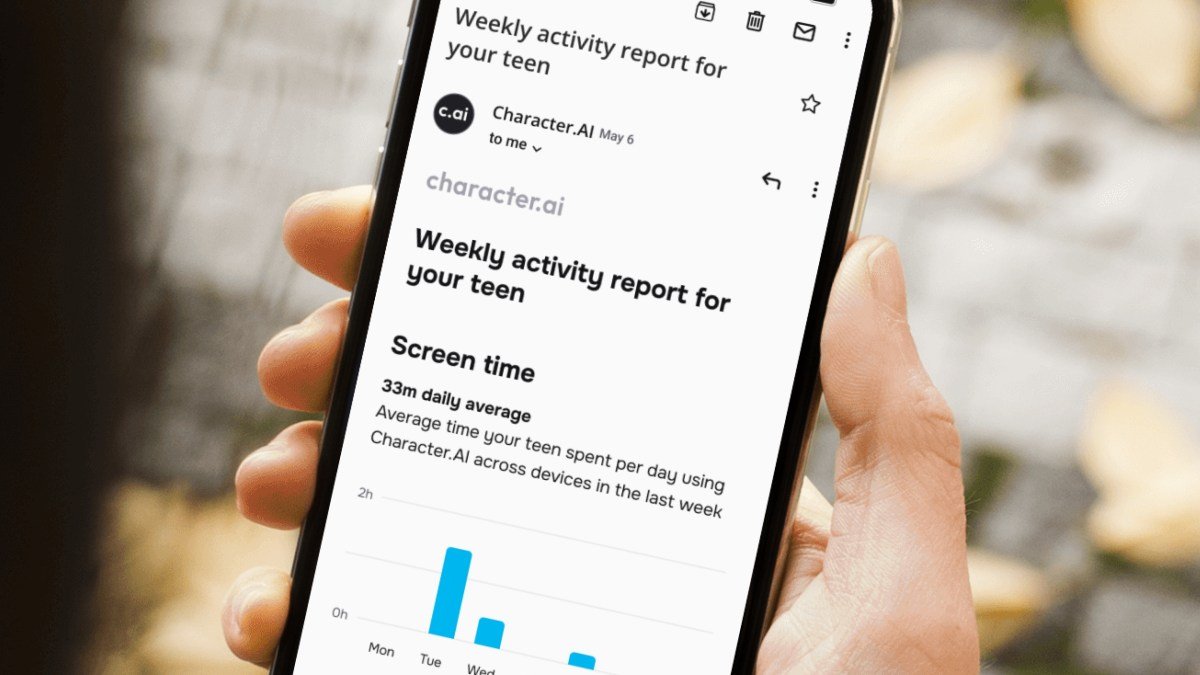

Character AI ahora les dará a los tutores y padres un resumen de la actividad de sus adolescentes en la aplicación a través de un correo electrónico semanal. Supuestamente, el correo electrónico mostrará el tiempo promedio que un niño pasa en la aplicación y en la web, el tiempo que pasan hablando con cada personaje y los personajes con los que interactuaron más durante la semana.

La startup dice que estos datos tienen como objetivo darles a los padres información sobre los hábitos de participación de sus adolescentes en la plataforma. Específicamente, los padres no tienen acceso directo a las conversaciones en sí mismas. Tras las demandas, el año pasado la startup añadió medidas de seguridad como un modelo dedicado para usuarios menores de 18 años, notificaciones de tiempo pasado y deslindes para recordar a los usuarios que están hablando con personajes impulsados por inteligencia artificial. La empresa también bloqueó contenido sensible para la entrada y salida mediante la creación de nuevos clasificadores para adolescentes.

A principios de este año, la startup presentó una moción para desechar una demanda que alegaba que la empresa había tenido un papel en el suicidio de un adolescente.

[[IMG::…]]